基于Flink的实时数据接入与处理服务实践

在当今数据驱动的时代,实时数据处理能力已成为企业数字化转型的核心竞争力之一。Apache Flink作为一个开源的流处理框架,以其高吞吐、低延迟、精确一次(Exactly-Once)的语义保证和强大的状态管理能力,成为构建实时数据管道与处理服务的首选技术之一。本文将探讨基于Flink构建实时数据接入与处理服务的核心实践。

一、 实时数据接入:构建可靠的数据入口

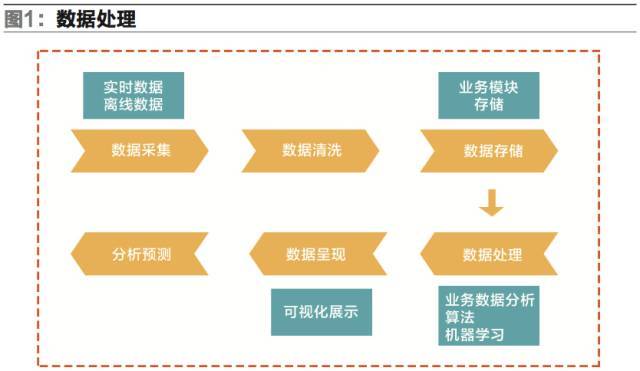

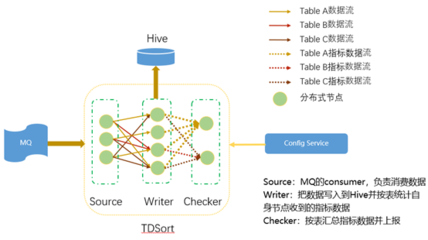

实时数据接入是数据处理服务的第一步,目标是将来自不同源头(如Kafka、数据库CDC、日志文件、物联网设备等)的数据,以流的形式可靠、高效地引入Flink处理管道。

- 连接器选择:Flink拥有丰富的连接器生态。对于消息队列,Kafka Connector是最常见的选择,它能很好地与Flink的检查点机制配合,实现端到端的精确一次处理。对于数据库变更,可使用Debezium等工具捕获CDC日志,再通过Kafka接入,或直接使用Flink CDC Connector。

- 反序列化与格式转换:接入原始数据流后,需进行反序列化(如将Kafka中的字节数组转换为JSON/AVRO对象)和初步的格式清洗,为后续处理做好准备。

- 动态发现与扩缩容:在生产环境中,数据源(如Kafka的Topic分区数)可能会变化。利用Flink的

Dynamic Source特性或Kafka Connector的分区发现功能,可以实现处理作业在不重启的情况下适应数据源的变化。

二、 核心数据处理:流式计算的威力

数据接入后,进入核心的处理阶段。Flink的DataStream API和Table API/SQL提供了强大的表达能力。

- 事件时间处理与乱序:实时数据常存在乱序和延迟。采用事件时间(Event Time)语义,并结合水印(Watermark)机制,是处理乱序、进行窗口计算的基石。合理设置水印延迟是平衡结果准确性和产出延迟的关键。

- 有状态计算:实时聚合、用户行为会话分析、模式检测等都依赖于状态。Flink提供了键控状态(Keyed State)和算子状态(Operator State),并支持将状态持久化到RocksDB等外部存储,保障故障恢复。状态TTL(生存时间)管理对于节省存储空间至关重要。

- 窗口操作:滚动窗口、滑动窗口、会话窗口是实时聚合的常用工具。Flink的窗口机制灵活,允许自定义触发器(Trigger)和驱逐器(Evictor)来实现复杂的窗口逻辑。

- 多流关联:在实时风控、实时推荐等场景,常常需要将多个数据流进行关联(Join)。Flink支持基于时间窗口的关联和基于间隔的关联,需根据业务逻辑的时效性要求进行选择。

三、 数据处理服务化:从作业到服务

将Flink作业部署并稳定运行,仅仅是开始。要将其构建成可管理、可观测、高可用的“数据处理服务”,还需要一系列工程化实践。

- 作业部署与资源管理:

- 部署模式:根据集群环境,可选择Per-Job模式(隔离性好)或Application模式(推荐,便于依赖管理)。在Kubernetes上部署Flink已成为云原生时代的主流选择。

- 资源规划:合理设置TaskManager的Slot数量、内存配置(托管内存、网络缓存、堆内存等),是作业稳定运行的保障。需要根据数据吞吐量和操作复杂度进行压测和调优。

- 高可用与容错:

- 检查点与保存点:定期触发检查点(Checkpoint)是Flink容错的核心。保存点(Savepoint)用于有计划的版本升级和作业迁移。建议将状态后端配置为分布式文件系统(如HDFS、S3)。

- 监控与告警:集成Metrics系统(如Prometheus)监控作业的吞吐量、延迟、背压、检查点时长/大小等关键指标。设置合理的告警规则,如长时间无数据流入、背压持续过高、检查点失败等。

- 数据质量与一致性:

- 端到端一致性:结合Kafka等具有事务能力的Sink,利用Flink的两阶段提交Sink函数实现端到端的精确一次语义。

- 数据稽核:在服务中内置数据稽核点,对比实时处理结果与离线批处理结果,监控数据一致性。

- 服务治理:

- 作业生命周期管理:通过REST API或管理平台,实现作业的启动、停止、从保存点恢复、状态查询等操作。

- 版本迭代与A/B测试:利用保存点实现作业的灰度发布和快速回滚。对于算法类处理逻辑,可设计旁路架构进行A/B测试。

四、 典型应用场景与挑战

基于Flink的实时数据处理服务已广泛应用于多个领域:

- 实时监控与告警:实时分析日志、指标,即时发现异常并触发告警。

- 实时数仓与报表:构建实时数据通道,将数据实时写入OLAP数据库(如ClickHouse、Druid),支撑实时大屏和即席查询。

- 实时推荐与风控:实时处理用户行为流,与模型服务交互,实现毫秒级的推荐和风险识别。

实践中也面临诸多挑战,如复杂业务逻辑下的状态管理优化、处理链路过长导致的延迟累积、反压场景下的资源与性能平衡、在超大规模数据流下维持端到端一致性的开销等,都需要结合具体业务进行深度优化。

构建基于Flink的实时数据接入与处理服务是一项系统工程,它不仅仅是编写一个流处理作业,更涵盖了从数据接入、核心计算到服务化运维的全链路。深入理解Flink的原理,并结合坚实的软件工程和运维实践,才能打造出稳定、高效、可信赖的实时数据处理能力,真正释放实时数据的业务价值。

如若转载,请注明出处:http://www.puhuoyi.com/product/13.html

更新时间:2026-04-16 08:14:43